В июне 2017 года группа инженеров Google Brain опубликовала статью с лаконичным названием «Attention Is All You Need». Никто тогда не мог предположить, что 8 страниц LaTeX-кода перекроят всю индустрию обработки естественного языка, а спустя несколько лет породят языковые модели, разговаривающие с людьми на уровне эксперта.

Восемь лет спустя трансформер стал базовой архитектурой не только для NLP, но и для компьютерного зрения (Vision Transformer), обработки аудио, белков (AlphaFold 2), видеогенерации и управления роботами. В этой статье мы разбираем, что именно изменилось в архитектуре за это время, что осталось прежним, и куда движется следующее поколение моделей.

Что было в оригинальной статье

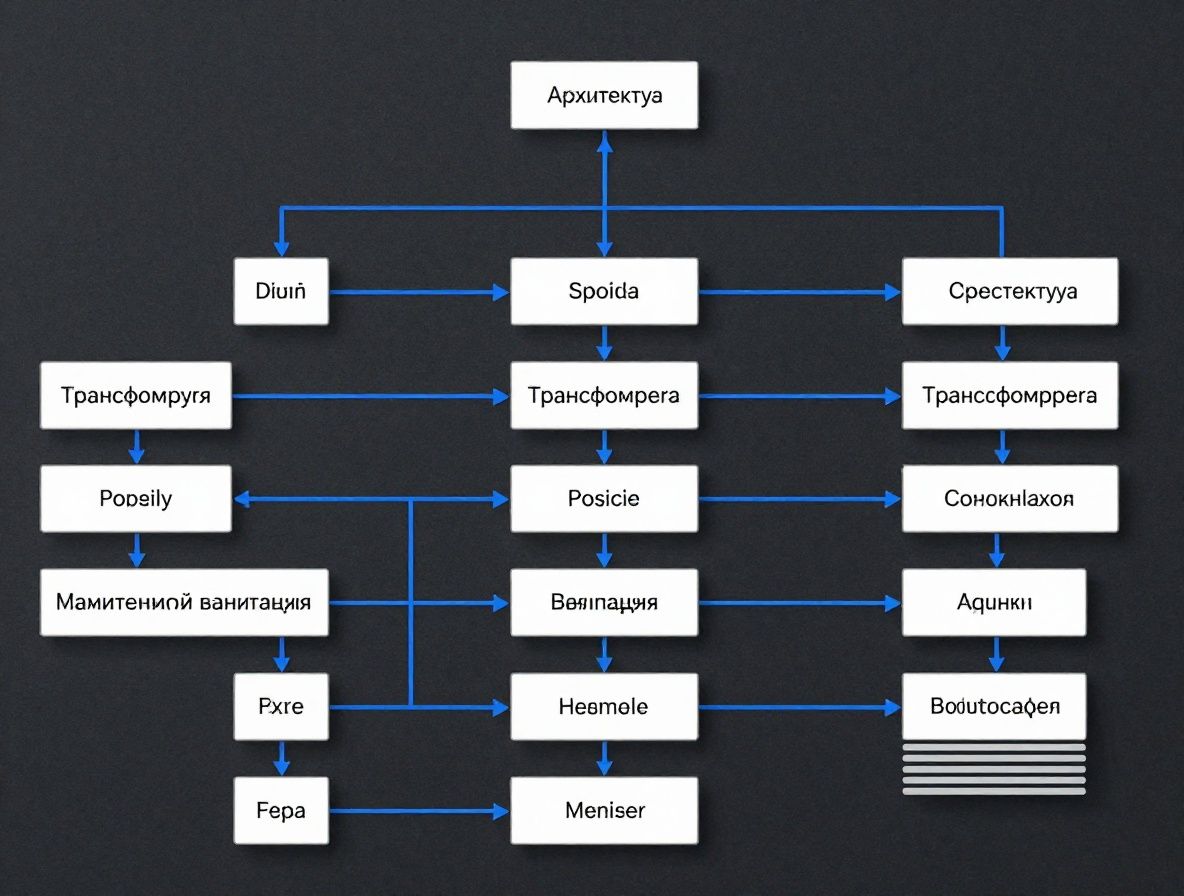

Оригинальная архитектура трансформера состояла из двух компонентов: энкодера и декодера, каждый из которых включал блоки Multi-Head Self-Attention и Feed-Forward Network. Ключевое нововведение — замена рекуррентности (RNN, LSTM) на механизм внимания, позволяющий модели обрабатывать все токены последовательности параллельно.

Механизм Scaled Dot-Product Attention вычислял взвешенную сумму значений (Values) на основе совместимости между запросами (Queries) и ключами (Keys). Позиционное кодирование с помощью синусоидальных функций позволяло сохранять информацию о порядке токенов.

Модель была обучена на задаче машинного перевода (WMT English-German, 4.5M пар) и достигла BLEU-score 28.4 — нового state-of-the-art результата на тот момент. При этом обучение заняло значительно меньше времени, чем предшествующие рекуррентные архитектуры.

BERT и GPT: две парадигмы применения трансформеров

В 2018 году произошло два переломных события. Google DeepMind представила BERT (Bidirectional Encoder Representations from Transformers), а OpenAI — GPT (Generative Pre-trained Transformer). Оба использовали трансформерную архитектуру, но с принципиально разными задачами предобучения.

BERT использовал двунаправленный энкодер и задачу Masked Language Modeling: модель обучалась предсказывать случайно замаскированные токены, опираясь на контекст с обеих сторон. Это сделало BERT идеальным для задач понимания текста: вопросно-ответные системы, классификация, NER.

GPT, напротив, использовал однонаправленный декодер с авторегрессионным предобучением: предсказание следующего токена. Это позволило модели генерировать связный текст и проявлять zero-shot способности к следованию инструкциям.

Масштабирование как стратегия: от миллионов к триллионам параметров

Ключевым открытием 2020-х стало то, что масштабирование (больше параметров + больше данных + больше вычислений) предсказуемо улучшает качество языковых моделей. Этот феномен был формализован в виде «законов масштабирования» (Scaling Laws) командами Kaplan et al. из OpenAI и Hoffmann et al. из DeepMind.

GPT-3 с 175 миллиардами параметров (2020) продемонстрировал впечатляющие few-shot и zero-shot возможности. Однако обучение такой модели потребовало порядка $4.6 миллиона только на вычисления. ChatGPT и GPT-4 добавили Reinforcement Learning from Human Feedback (RLHF), существенно улучшив следование инструкциям.

Технические улучшения: что изменилось под капотом

За восемь лет архитектура трансформера претерпела множество технических улучшений:

- Relative Positional Encodings (T5, RoPE в LLaMA) заменили абсолютные синусоидальные кодировки, улучшив обобщение на длинных контекстах.

- Flash Attention (2022, Tri Dao et al.) — алгоритм вычисления attention с тайлингом, снизивший использование памяти с O(n²) до O(n) и ускоривший обучение в 2–4 раза.

- Grouped Query Attention (GQA) в Llama 2 уменьшил использование KV-cache при inference.

- Mixture of Experts (MoE) в Mixtral 8x7B и GPT-4 позволил существенно увеличить число параметров без пропорционального роста вычислений.

- RMSNorm вместо LayerNorm обеспечил более стабильное обучение при меньших вычислительных затратах.

State Space Models: потенциальный конкурент

В 2023–2024 годах появился класс архитектур State Space Models (SSM), наиболее известный представитель — Mamba от Альберта Гу и Три Дао. SSM обещают линейную вычислительную сложность по длине контекста вместо квадратичной у трансформеров, что критично для работы с очень длинными последовательностями.

Однако на практике Mamba и гибридные архитектуры (Jamba, Zamba) пока уступают трансформерам на задачах, требующих точного recall — воспроизведения конкретной информации из длинного контекста. Исследования продолжаются, и вопрос о преемнике трансформера остается открытым.

Что не изменилось

Несмотря на все инновации, ядро трансформерной архитектуры остается удивительно стабильным: Multi-Head Attention, Feed-Forward Network, Layer Normalization, Residual Connections. Эта простота и масштабируемость — вероятно, главный секрет успеха архитектуры.

Трансформер стал для нейронных сетей тем же, чем Unix стал для операционных систем: базовой абстракцией, поверх которой строится огромный стек последующих разработок.

Взгляд вперед

На горизонте — архитектуры с более эффективными механизмами памяти (memory-augmented transformers), мультимодальные нейтивные модели (GPT-4V, Gemini), специализированные малые модели (SLM), оптимизированные для конкретных задач, и нейроморфные подходы к вычислениям.

Одно можно утверждать с уверенностью: 8 страниц той статьи 2017 года дали толчок, последствия которого мы будем ощущать еще долго.

Источники:

- Vaswani et al. (2017). Attention Is All You Need. arXiv:1706.03762

- Devlin et al. (2018). BERT: Pre-training of Deep Bidirectional Transformers. arXiv:1810.04805

- Kaplan et al. (2020). Scaling Laws for Neural Language Models. arXiv:2001.08361

- Dao et al. (2022). FlashAttention: Fast and Memory-Efficient Exact Attention. arXiv:2205.14135

- Gu & Dao (2023). Mamba: Linear-Time Sequence Modeling. arXiv:2312.00752